ICLR 2026|原生多模态推理新范式ThinkMorph ,让文字与图像在统一架构中共同演化

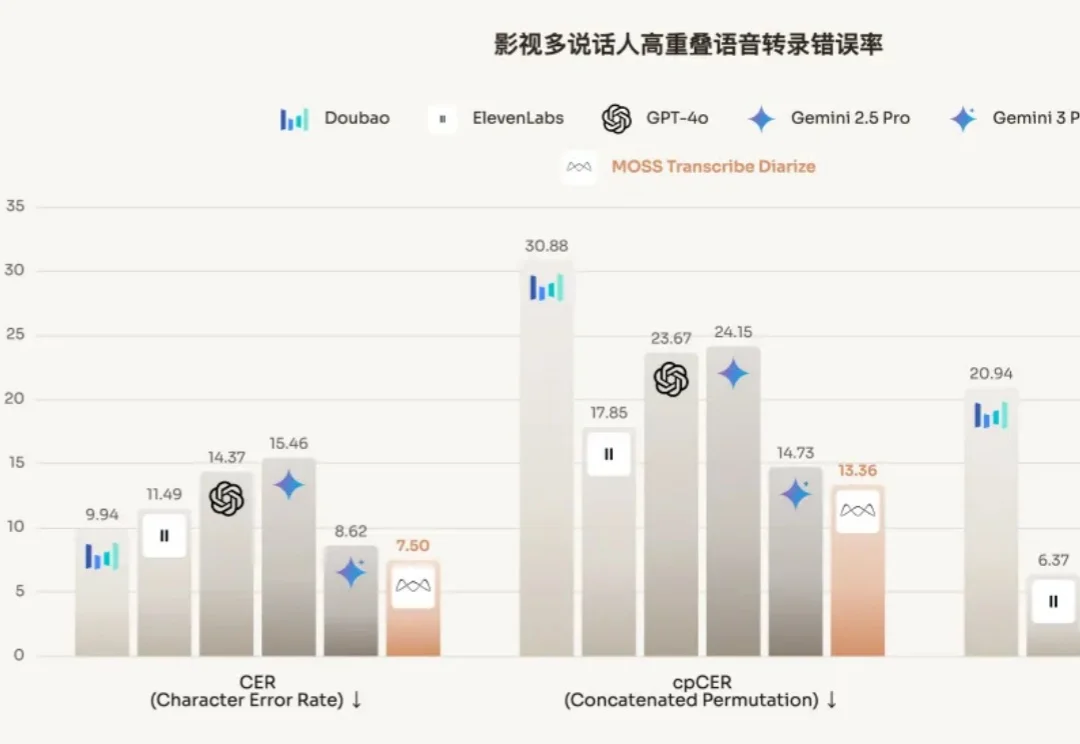

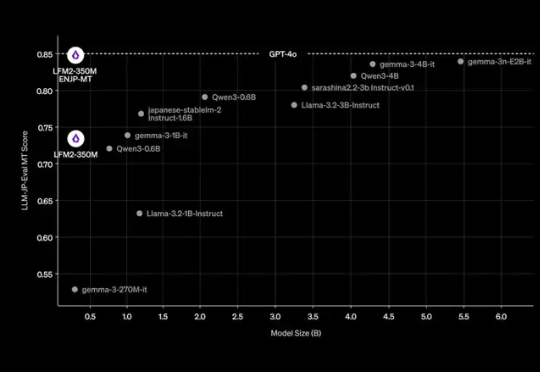

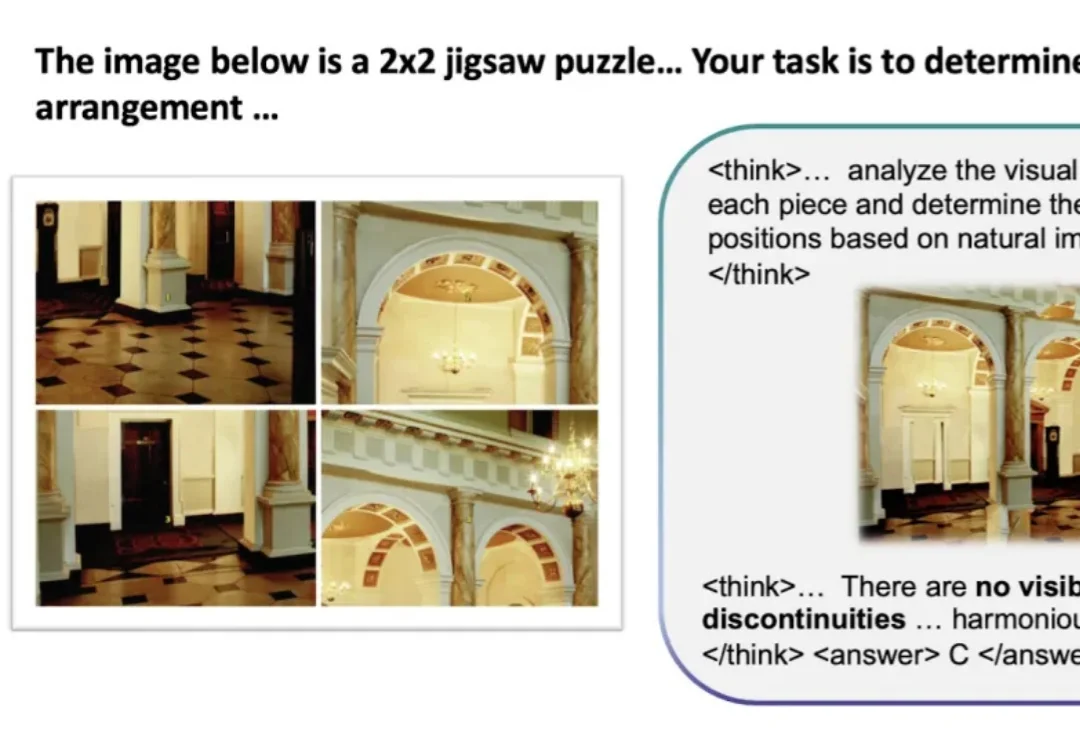

ICLR 2026|原生多模态推理新范式ThinkMorph ,让文字与图像在统一架构中共同演化NUS、ZJU、UW、Stanford、CUHK 联合提出 「ThinkMorph」,主张让文字与图像在统一架构里「原生协作」、「共同演化」,而不是像当下大多数多模态模型那样,看完图像就闭上眼睛,后续完全靠文字链条推进。仅用 2.4 万条数据微调 7B 统一模型,视觉推理平均提升 34.74%,多项任务比肩甚至超越 GPT-4o 和 Gemini 2.5 Flash。